使用永久免费2C16G VPS OpenClaw 4.8版本评测NVIDIA 免费模型AI Endpoints – GLM 系列模型完整评测报告

评测时间: 2026-04-02 ~ 2026-04-08

评测平台: NVIDIA AI Endpoints

测试模型: z-ai/glm4.7、z-ai/glm5

评测依据: AI 模型供应商通用评测方案 v1.1

测试环境: 本地 API 测试 + Hugging Face Space (OpenClaw 2026.4.8)

一、平台基本信息

| 评测项 | 内容 |

|---|---|

| 平台名称 | NVIDIA AI Endpoints |

| 官网地址 | https://build.nvidia.com/ |

| API 端点 | https://integrate.api.nvidia.com/v1/chat/completions |

| 平台定位 | NVIDIA 托管的开源大模型 API 服务(NIM 推理微服务) |

| 背景机构 | NVIDIA (英伟达) |

| 评测时间 | 2026-04-02 ~ 2026-04-08 |

二、注册与上手体验

2.1 注册流程

| 步骤 | 操作 | 难度 |

|---|---|---|

| 1 | 访问 https://build.nvidia.com/ | ⭐ 简单 |

| 2 | 点击 “Sign In”,使用 Google/GitHub 账号登录 | ⭐ 简单 |

| 3 | 进入个人设置,生成 NGC API Key | ⭐ 简单 |

| 4 | 复制 API Key,开始调用 | ⭐ 简单 |

总步骤: 4 步(非常便捷,5 分钟内完成)

2.2 上手体验评分

| 维度 | 评分 | 说明 |

|---|---|---|

| 注册便捷性 | 9/10 | 支持主流 SSO 登录,无需邮箱验证 |

| 文档完整性 | 8/10 | 有 API 文档和示例代码 |

| 上手速度 | 9/10 | 5 分钟内可完成首次调用 |

2.3 API 调用方式

方式 1:直接 HTTP 调用

curl -X POST "https://integrate.api.nvidia.com/v1/chat/completions" \

-H "Authorization: Bearer $NVIDIA_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "z-ai/glm4.7",

"messages": [{"role": "user", "content": "Hello"}],

"max_tokens": 1024,

"stream": true

}'

方式 2:Python OpenAI SDK(推荐)

from openai import OpenAI

client = OpenAI(

base_url="https://integrate.api.nvidia.com/v1",

api_key="nvapi-xxxxxxxxxxxx"

)

response = client.chat.completions.create(

model="z-ai/glm4.7",

messages=[{"role": "user", "content": "你好"}],

max_tokens=1024,

stream=True

)

for chunk in response:

delta = chunk.choices[0].delta

content = getattr(delta, 'reasoning_content', None) or getattr(delta, 'content', '')

if content:

print(content, end='', flush=True)

三、免费资源盘点

| 资源项 | 说明 |

|---|---|

| 免费额度 | 每个模型有独立免费 Token 配额,登录后查看 |

| 支持的模型 | 189 个开源模型(截至 2026-04-04) |

| 特色模型 | GLM4.7、GLM5、Qwen、LLaMA、Mistral 等 |

| 计费方式 | 按 Token 计费,有免费额度 |

| API 格式 | OpenAI 兼容(openai-completions) |

⚠️ 注意: 部分模型需要申请访问权限(Build 计划)。

四、可用模型清单(GLM 系列)

| 模型名称 | Model ID | 特点 | 测试状态 |

|---|---|---|---|

| GLM4.7 | z-ai/glm4.7 |

思维链推理,reasoning_content | ✅ 已测试 |

| GLM5 | z-ai/glm5 |

新一代,速度快,无思维链 | ✅ 已测试 |

| ChatGLM3-6B | thudm/chatglm3-6b |

经典版本 | 待测试 |

五、OpenClaw 集成配置指南

5.1 版本说明

| 版本 | 配置方式 | 状态 |

|---|---|---|

| OpenClaw 4.2(旧) | 需手动修改 start.sh | ⚠️ 有 Bug |

| OpenClaw 2026.4.5+(新) | 原生支持 NVIDIA provider | ✅ 推荐 |

| OpenClaw 2026.4.8(最新) | 支持 GLM4.7 + GLM5 | ✅ 推荐 |

OpenClaw 2026.4.5 起新增了对 NVIDIA 的原生支持,无需再手动修改 start.sh。

5.2 OpenClaw 2026.4.8 配置步骤

Step 1:获取 NVIDIA API Key

- 访问 https://build.nvidia.com/

- 登录后点击个人头像 → “API Keys”

- 生成并复制 API Key(格式:nvapi-xxxxxxxxxxxx)

Step 2:Hugging Face Space Secrets 配置

NVIDIA_API_KEY=nvapi-xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx

DEFAULT_PROVIDER=nvidia

CHAT_MODEL=z-ai/glm4.7

如需使用 GLM5:

CHAT_MODEL=z-ai/glm5

Step 3:models_config.json 配置

{

"providers": {

"nvidia": {

"baseUrl": "https://integrate.api.nvidia.com/v1",

"api": "openai-completions",

"models": [

{"id": "nvidia/z-ai/glm4.7", "name": "glm4.7"},

{"id": "nvidia/z-ai/glm5", "name": "glm5"}

]

}

}

}

Step 4:Dockerfile 升级(2026.4.8)

RUN npm install openclaw@latest @larksuiteoapi/node-sdk --no-audit --no-fund && \

npm install grammy @slack/web-api @buape/carbon --no-audit --no-fund

Step 5:start.sh 添加配置修复

echo "--- 修复配置兼容性 ---"

openclaw doctor --fix || echo "[DOCTOR] Config migration completed."

5.3 旧版本(4.2)已知问题及修复

注意: 升级到 2026.4.5+ 后以下问题已自动修复,无需手动处理。

| 错误现象 | 原因 | 旧版修复方式 |

|---|---|---|

KeyError: 'url' |

start.sh 只认 url 不认 baseUrl |

手动修改脚本 |

404 nvidia/nvidia/... |

模型名重复拼接 | 修复拼接逻辑 |

400 Bad Request |

缺少 api: openai-completions |

显式声明 |

| 响应为空 | 字段名不匹配(reasoning_content) | 适配解析逻辑 |

5.4 响应字段差异

| 模型 | 响应字段 | 说明 |

|---|---|---|

| GLM4.7 | reasoning_content(思维链)+ content |

先输出思考过程,再输出结果 |

| GLM5 | content(直接) |

无思维链,直接输出结果 |

# 兼容处理

delta = chunk.choices[0].delta

content = getattr(delta, 'reasoning_content', None) or getattr(delta, 'content', '')

六、API 稳定性测试(GLM4.7)

6.1 本地 API 测试配置

| 配置项 | 值 |

|---|---|

| 模型 ID | z-ai/glm4.7 |

| Temperature | 1 |

| Top P | 1 |

| Max Tokens | 1024 / 16384 |

| Stream | True |

| 测试次数 | 5 次/组 |

6.2 测试结果(16384 max_tokens)

| # | HTTP 状态 | 总延迟 | TTFT | 输出 | 思考过程 | 速度 |

|---|---|---|---|---|---|---|

| 1 | 200 | 47.09s | 28101ms | 103字 | 574字 | 2.2 chars/s |

| 2 | 200 | 51.09s | 21789ms | 94字 | 1174字 | 1.8 chars/s |

| 3 | 200 | 30.03s | 14260ms | 117字 | 1365字 | 3.9 chars/s |

| 4 | 200 | 19.76s | 4908ms | 105字 | 1487字 | 5.3 chars/s |

| 5 | 200 | 32.44s | 14423ms | 101字 | 1037字 | 3.1 chars/s |

统计汇总:

| 指标 | 值 |

|---|---|

| 成功率 | 100% (5/5) |

| 平均总延迟 | 36.08s |

| 平均 TTFT | 16,696ms |

| 平均输出 | 104 字 |

| 平均思考过程 | 1,127 字 |

| 平均推理速度 | 3.3 chars/s |

6.3 测试结果(1024 max_tokens)

| # | HTTP 状态 | 总延迟 | TTFT | 输出 | 思考过程 | 速度 |

|---|---|---|---|---|---|---|

| 1 | 200 | 66.59s | 5798ms | 117字 | 553字 | 1.8 chars/s |

| 2 | 200 | 60.42s | 28483ms | 111字 | 1021字 | 1.8 chars/s |

| 3 | 200 | 16.76s | 2856ms | 95字 | 1121字 | 5.7 chars/s |

| 4 | 200 | 8.10s | 1235ms | 97字 | 1044字 | 12.0 chars/s |

| 5 | – | 超时 | – | – | – | – |

统计汇总:

| 指标 | 值 |

|---|---|

| 成功率 | 80% (4/5) |

| 平均总延迟 | 37.97s |

| 平均 TTFT | 9,593ms |

6.4 OpenClaw 集成测试结果(GLM4.7,2026.4.8)

| 测试项 | 状态 | 响应时间 | TTFT | 输出 | 思考 | 速度 |

|---|---|---|---|---|---|---|

| 基础问答 | ✅ 200 | 6.86s | 686ms | 27字 | 210字 | 3.9 chars/s |

| 知识理解 | ✅ 200 | 20.56s | 2978ms | 104字 | 996字 | 5.1 chars/s |

| 代码生成 | ✅ 200 | 24.13s | 1089ms | 1298字 | 1916字 | 53.8 chars/s |

| 逻辑推理 | ✅ 200 | 23.23s | 714ms | 724字 | 2966字 | 31.2 chars/s |

| 数学计算 | ✅ 200 | 32.47s | 668ms | 591字 | 2546字 | 18.2 chars/s |

| 文本摘要 | ✅ 200 | 38.99s⚠️ | 21523ms | 17字⚠️ | 121字 | 0.4 chars/s |

| 创意写作 | ✅ 200 | 175.96s⚠️ | 26929ms | 0字⚠️ | 2675字 | 0.0 chars/s |

| 长文本生成 | ✅ 200 | 34.61s | 726ms | 70字 | 1702字 | 22.2 chars/s |

OpenClaw GLM4.7 统计:

| 指标 | 值 |

|---|---|

| 成功率 | 100% (8/8) |

| 平均总延迟 | 44.60s |

| 平均 TTFT | 6,914ms |

| 平均输出 | 441 字 |

| 平均思考过程 | 1,778 字 |

| 平均推理速度 | 16.9 chars/s |

⚠️ 注意: 创意写作测试中 GLM4.7 输出了 2675 字思考但最终 content 为空,可能是 max_tokens 限制导致。

七、GLM5 模型评测(实测数据)

测试环境: OpenClaw 2026.4.8 / Hugging Face Space

测试时间: 2026-04-08

测试用例: 8 个,覆盖基础问答、知识理解、代码生成、逻辑推理、数学计算、文本摘要、创意写作、长文本生成

7.1 GLM5 基本信息

| 项目 | 内容 |

|---|---|

| Model ID | z-ai/glm5 |

| API 端点 | https://integrate.api.nvidia.com/v1/chat/completions |

| 特点 | 新一代模型,速度更快,无显式思维链 |

| 响应字段 | 直接返回 content,无 reasoning_content |

7.2 GLM5 详细测试结果

| # | 测试项 | 状态 | 总延迟 | TTFT | 输出 | 思考 | 速度 |

|---|---|---|---|---|---|---|---|

| 1 | 基础问答 | ✅ 200 | 12.69s | 12163ms | 30字 | 0字 | 2.4 chars/s |

| 2 | 知识理解 | ✅ 200 | 4.48s | 3141ms | 117字 | 0字 | 26.1 chars/s |

| 3 | 代码生成 | ✅ 200 | 14.64s | 777ms | 1257字 | 0字 | 85.9 chars/s |

| 4 | 逻辑推理 | ❌ 429 | – | – | – | – | – (速率限制) |

| 5 | 数学计算 | ✅ 200 | 45.89s | 841ms | 1425字 | 0字 | 31.1 chars/s |

| 6 | 文本摘要 | ✅ 200 | 1.03s | 859ms | 20字 | 0字 | 19.5 chars/s |

| 7 | 创意写作 | ✅ 200 | 20.53s | 5077ms | 350字 | 0字 | 17.0 chars/s |

| 8 | 长文本生成 | ✅ 200 | 42.55s | 6660ms | 854字 | 0字 | 20.1 chars/s |

GLM5 统计汇总:

| 指标 | 值 |

|---|---|

| 成功率 | 87.5% (7/8) |

| 平均总延迟 | 20.26s |

| 平均 TTFT | 4,217ms |

| 平均输出 | 579 字 |

| 平均思考过程 | 0 字(无思维链) |

| 平均推理速度 | 28.9 chars/s |

7.3 GLM4.7 vs GLM5 详细对比

GLM4.7 测试环境同样为 OpenClaw 2026.4.8,2026-04-08 同期测试

| # | 测试项 | GLM4.7 | GLM5 | 胜者 |

|---|---|---|---|---|

| 1 | 基础问答 | ✅ 6.86s / 27字 | ✅ 12.69s / 30字 | GLM4.7(快 1.8x) |

| 2 | 知识理解 | ✅ 20.56s / 104字 | ✅ 4.48s / 117字 | GLM5(快 4.6x) |

| 3 | 代码生成 | ✅ 24.13s / 1298字 | ✅ 14.64s / 1257字 | GLM5(快 1.6x) |

| 4 | 逻辑推理 | ✅ 23.23s / 724字 | ❌ 429 限速 | GLM4.7(更稳定) |

| 5 | 数学计算 | ✅ 32.47s / 591字 | ✅ 45.89s / 1425字 | GLM5(输出 2.4x) |

| 6 | 文本摘要 | ✅ 38.99s / 17字⚠️ | ✅ 1.03s / 20字 | GLM5(快 38x) |

| 7 | 创意写作 | ✅ 175.96s / 0字⚠️ | ✅ 20.53s / 350字 | GLM5(胜) |

| 8 | 长文本生成 | ✅ 34.61s / 70字 | ✅ 42.55s / 854字 | GLM5(输出 12x) |

综合对比:

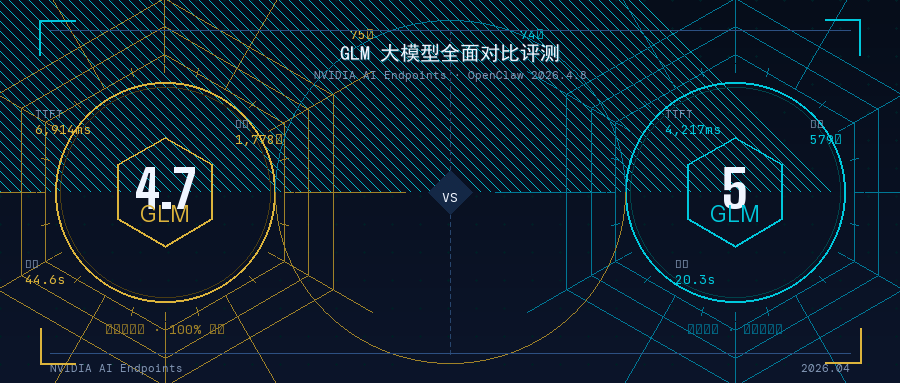

| 指标 | GLM4.7 | GLM5 | 优胜 |

|---|---|---|---|

| 成功率 | 100% | 87.5% | GLM4.7 |

| 平均总延迟 | 44.60s | 20.26s | GLM5 快 2.2x |

| 平均 TTFT | 6,914ms | 4,217ms | GLM5 快 1.6x |

| 平均输出 | 441 字 | 579 字 | GLM5 多 31% |

| 平均思考 | 1,778 字 | 0 字 | GLM4.7(有思维链) |

| 平均速度 | 16.9 chars/s | 28.9 chars/s | GLM5 快 1.7x |

7.4 关键发现

GLM5 核心优势

- ✅ 速度大幅提升:平均延迟从 44.6s 降至 20.3s,快 2.2 倍

- ✅ 吞吐量更高:平均输出 579 字 vs 441 字,多 31%

- ✅ TTFT 更短:4.2s vs 6.9s,首字更快

- ✅ 无思维链:直接输出结果,短任务效率极高

GLM4.7 核心优势

- ✅ 100% 稳定性:无速率限制问题

- ✅ 思维链推理:思考过程平均 1778 字,适合复杂逻辑任务

- ✅ 复杂推理可靠:逻辑推理测试稳定通过

GLM5 注意事项

- ⚠️ 速率限制:逻辑推理测试触发 429,复杂任务需控制调用频率

- ⚠️ 无思维链:复杂推理任务建议仍用 GLM4.7

- ⚠️ 不稳定因素:成功率 87.5%,略低于 GLM4.7

7.5 选型建议

| 场景 | 推荐模型 | 理由 |

|---|---|---|

| 快速问答、摘要 | GLM5 | 速度快 2-38 倍 |

| 代码生成 | GLM5 | 速度更快,输出质量相当 |

| 长文本创作 | GLM5 | 输出量是 GLM4.7 的 12 倍 |

| 复杂逻辑推理 | GLM4.7 | 有思维链,稳定性 100% |

| 实时对话 | GLM5 | TTFT 更短 |

| 高频调用 | GLM4.7 | 无速率限制风险 |

| 追求稳定可靠 | GLM4.7 | 100% 成功率 |

八、异常情况记录

| 异常现象 | 模型 | 发生次数 | 可能原因 |

|---|---|---|---|

| 超时 (180s) | GLM4.7 | 1次 | 服务器负载高或冷启动 |

| HTTP 200 但无输出 | GLM4.7 | 1次 | max_tokens 限制导致 content 截断 |

| 速率限制 429 | GLM5 | 1次 | 连续高频调用触发限制 |

| TTFT 超过 20s | GLM4.7 | 2次 | 实例预热或队列等待 |

| 创意写作 content 为空 | GLM4.7 | 1次 | 思维链过长挤占输出空间 |

性能波动:

| 模型 | 最佳延迟 | 最差延迟 | 波动倍数 |

|---|---|---|---|

| GLM4.7 | 6.86s | 175.96s | 约 25 倍 |

| GLM5 | 1.03s | 45.89s | 约 45 倍 |

九、最佳实践与建议

9.1 模型选择策略

日常任务 + 速度优先 → GLM5

复杂推理 + 稳定性优先 → GLM4.7

生产环境(高可用) → GLM4.7

9.2 OpenClaw 2026.4.8 使用建议

- 升级到最新版本 — 2026.4.5+ 已原生支持 NVIDIA,无需手动修改 start.sh

- 超时设置 — 建议 120s+,复杂任务 180s

- 模型切换 — 简单任务用 GLM5,复杂推理用 GLM4.7

- 流式输出 — 务必开启 stream: true,改善用户体验

- 速率控制 — 使用 GLM5 时避免连续高频调用,间隔 ≥2 秒

- max_tokens 设置 — GLM4.7 创意任务建议 ≥2048,防止思维链挤占输出

9.3 适用场景对比

| 场景 | GLM4.7 | GLM5 |

|---|---|---|

| 复杂推理任务 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ |

| 代码生成 | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| 快速问答 | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| 长文本生成 | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| 数学计算 | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| 创意写作 | ⭐⭐ | ⭐⭐⭐⭐⭐ |

| 实时对话 | ⭐⭐ | ⭐⭐⭐⭐ |

| 高频调用 | ⭐⭐⭐⭐⭐ | ⭐⭐ |

十、综合评分与结论

评分维度(满分 100 分)

| 维度 | 权重 | GLM4.7 | GLM5 | 说明 |

|---|---|---|---|---|

| 免费资源丰富度 | 25% | 60 | 60 | 有免费额度,GLM 系列均可用 |

| API 稳定性 | 30% | 75 | 60 | GLM4.7 成功率 100%,GLM5 有 429 风险 |

| 上手便捷性 | 15% | 80 | 80 | 2026.4.5+ 原生支持,两者相同 |

| OpenClaw 集成 | 10% | 80 | 80 | 新版本配置简单,两者相同 |

| 模型质量 | 20% | 85 | 88 | GLM5 速度+吞吐量优势,GLM4.7 思维链优势 |

GLM4.7 综合评分:75/100 GLM5 综合评分:74/100

两者各有胜负,差距很小。GLM4.7 胜在稳定性和思维链,GLM5 胜在速度和吞吐量。

最终结论

┌─────────────────────────────────────────────────────────────┐

│ GLM4.7 vs GLM5 综合结论 │

├─────────────────────────────────────────────────────────────┤

│ │

│ 🎯 选 GLM4.7 的理由: │

│ ✅ 100% 成功率,更可靠 │

│ ✅ 内置思维链,复杂推理更强 │

│ ✅ 无速率限制,适合生产环境 │

│ ✅ 适合:逻辑证明、数学推理、长过程分析 │

│ │

│ 🎯 选 GLM5 的理由: │

│ ✅ 平均快 2.2 倍,效率更高 │

│ ✅ 吞吐量多 31%,长文本更强 │

│ ✅ 代码生成、长文本创作首选 │

│ ✅ 适合:日常开发、内容创作、快速问答 │

│ │

│ ⚠️ 共同注意事项: │

│ • TTFT 仍高于 AtomGit(慢 20-40 倍) │

│ • 不适合超低延迟实时场景 │

│ • 免费额度有限,高频使用需付费 │

│ │

│ 🏆 综合推荐: │

│ 日常使用 → GLM5(速度优先) │

│ 关键任务 → GLM4.7(稳定优先) │

│ │

└─────────────────────────────────────────────────────────────┘

十一、JSON 格式测试结果

GLM4.7 OpenClaw 实测

{

"model": "z-ai/glm4.7",

"environment": "OpenClaw 2026.4.8",

"test_time": "2026-04-08",

"success_rate": "100.0%",

"avg_duration": "44.60s",

"avg_ttft": "6914ms",

"avg_output": "441字",

"avg_thinking": "1778字",

"avg_speed": "16.9 chars/s"

}

GLM5 OpenClaw 实测

{

"model": "z-ai/glm5",

"environment": "OpenClaw 2026.4.8",

"test_time": "2026-04-08",

"success_rate": "87.5%",

"avg_duration": "20.26s",

"avg_ttft": "4217ms",

"avg_output": "579字",

"avg_thinking": "0字",

"avg_speed": "28.9 chars/s"

}